Prof. dr. Julia Bergman heeft een reputatie. Ze is de academicus die geen blad voor de mond neemt, die leveranciers op congressen confronteert met ongemakkelijke vragen, die de assessment-industrie een spiegel voorhoudt die niet iedereen wil zien.

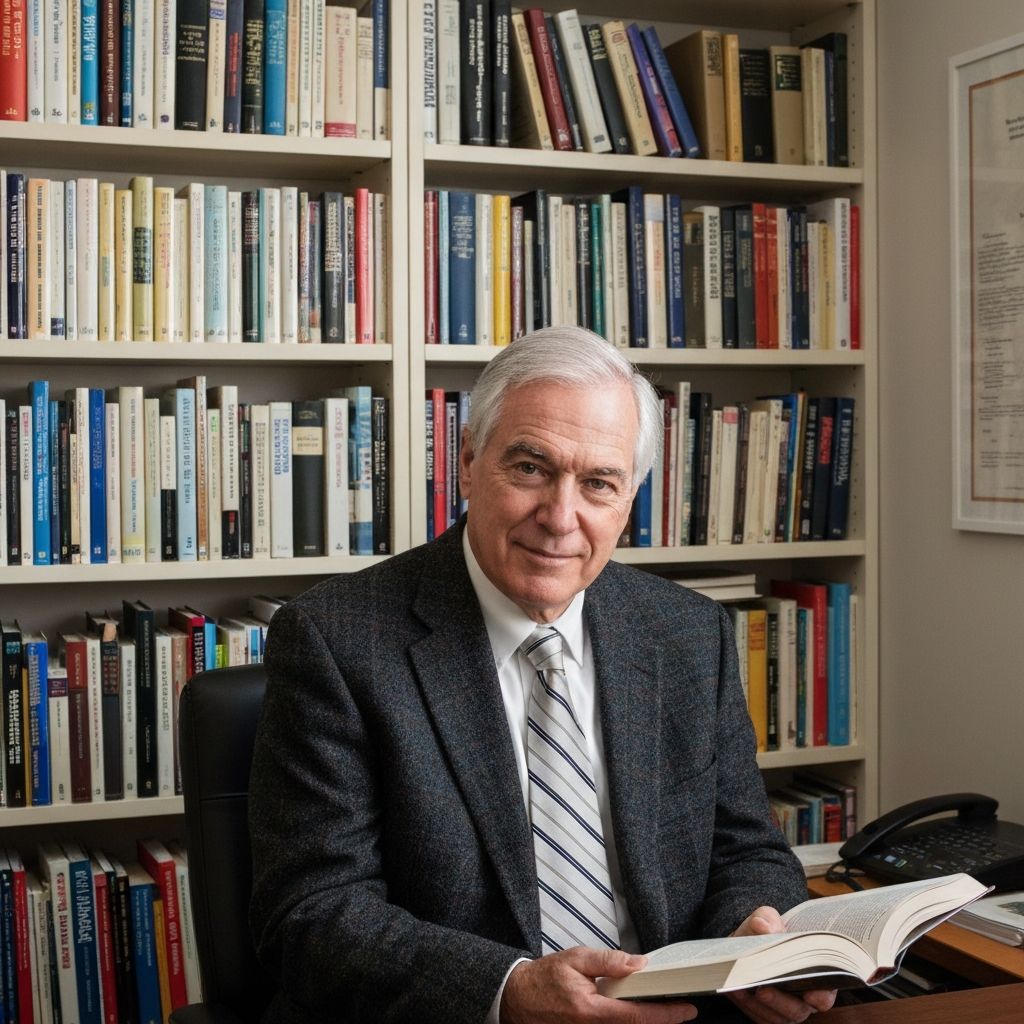

We treffen haar in haar werkkamer aan de Universiteit Utrecht. Boekenkasten vol filosofie en technologie-ethiek. Een poster met de tekst "Algorithm Is Not Neutral". Ze komt direct ter zake.

"De assessment-industrie loopt achter op andere sectoren als het gaat om AI-ethiek", opent ze. "Financiële dienstverlening heeft regulering. Gezondheidszorg heeft protocollen. Maar HR? Daar kan nog van alles."

Het fundamentele probleem

Bergman legt het kernprobleem uit: "Elk AI-systeem dat getraind is op historische data, reproduceert historische patronen. Als je verleden bias bevat - en dat doet het vrijwel altijd - zal je AI die bias versterken."

Ze geeft een voorbeeld: "Stel, je traint een systeem op succesvolle medewerkers uit het verleden. Als die historisch overwegend wit en mannelijk waren, leert het systeem dat wit en mannelijk voorspellers zijn van succes. Niet omdat dat waar is, maar omdat dat de patronen in de data zijn."

De onderzoeken naar AI-bias bevestigen dit beeld. Video-interview analyse discrimineert op accenten. Cv-screening reproduceert historische vooroordelen. Het is geen theoretisch risico - het is gedocumenteerde realiteit.

Wat moeten organisaties doen?

Bergman is pragmatisch in haar adviezen:

"Ten eerste: audit je systemen regelmatig. Niet eenmalig bij aanschaf, maar doorlopend. Bias kan opduiken door veranderingen in data of context."

"Ten tweede: eis transparantie van je leveranciers. Als ze niet kunnen uitleggen hoe hun systeem werkt, koop het dan niet. Black boxes horen niet thuis in high-stakes beslissingen."

"Ten derde: houd menselijk toezicht. De EU AI Act vereist dit straks, maar het is sowieso goed beleid. Algoritmes maken fouten. Mensen moeten kunnen corrigeren."

De hoopvolle noot

Ondanks haar kritische toon ziet Bergman ook positieve ontwikkelingen. "De EU AI Act dwingt de industrie tot actie. Dat is hard nodig. En ik zie steeds meer bedrijven die het serieus nemen."

Ze noemt Selection Lab als voorbeeld. "Hun keuze om AI te beperken tot procesautomatisering en de beoordeling over te laten aan gevalideerde assessments - dat is precies de juiste benadering. AI waar het veilig kan, menselijk oordeel waar het moet."

"We staan op een kruispunt", concludeert ze. "AI in HR kan een kracht ten goede zijn - efficiënter, eerlijker, schaalbaarder. Of het kan bestaande ongelijkheden versterken. De keuze is aan ons."